MotionScan transforma las expresiones faciales en los videojuegos, logrando un realismo impresionante. Actores reales se someten a sesiones en un estudio equipado con docenas de cámaras que capturan cada detalle facial en 3D.

MotionScan transforma las expresiones faciales en los videojuegos, logrando un realismo impresionante. Actores reales se someten a sesiones en un estudio equipado con docenas de cámaras que capturan cada detalle facial en 3D.

Los jugadores apasionados conocen bien la montaña rusa emocional de sus títulos favoritos: la euforia de una victoria en una carrera frenética de Super Mario Kart o la decepción de ser derrotado en una épica batalla de World of Tanks.

Sin embargo, los personajes animados en pantalla rara vez reflejan esas emociones con la misma intensidad. Sus rasgos suelen ser rudimentarios, carentes del realismo que los haría verdaderamente convincentes.

Esto está cambiando gracias a MotionScan, la tecnología de animación facial desarrollada por Depth Analysis, una empresa australiana especializada en captura de movimiento. Ahora, los personajes de los videojuegos exhiben expresiones faciales más realistas que nunca.

La tecnología de animación facial es una evolución avanzada de la captura de movimiento, utilizada durante años en cine para efectos especiales. Si has visto escenas detrás de cámaras de películas como El Señor de los Anillos, reconocerás el proceso: actores con trajes ajustados cubiertos de marcadores (similares a bolas de golf) actúan frente a fondos verdes o azules.

Estos marcadores permiten a las cámaras rastrear los movimientos del actor. Posteriormente, los animadores crean esqueletos digitales que imitan esos gestos y los aplican a personajes virtuales. Sin embargo, estas animaciones a menudo fallan en capturar un lenguaje corporal y expresiones faciales precisos.

Para los desarrolladores de videojuegos, esto es un desafío clave, ya que los humanos reconocemos unas 250.000 expresiones faciales y dependemos del lenguaje corporal en hasta el 65% de nuestras interacciones [fuente: Pease].

Lanzada en 2010, MotionScan captura rasgos faciales para diferenciar con precisión emociones como disgusto de felicidad o curiosidad de desinterés, creando personajes con un lenguaje corporal auténtico.

Contenido- El Rostro de la Revolución

- ¡Luces, cámara(s), acción en 3D!

- ¡En tu cara, película!

- Evolución del movimiento

El Rostro de la Revolución

Es casi indistinguible de la realidad. Este ejemplo muestra el detalle extremo capturado por MotionScan.

Es casi indistinguible de la realidad. Este ejemplo muestra el detalle extremo capturado por MotionScan.

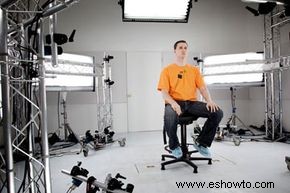

Aunque jugamos en pantallas 2D, el mundo real es 3D, al igual que los rostros humanos. MotionScan supera este reto con un estudio a prueba de luz y sonido, equipado con hardware y software de vanguardia.

Se graban actores reales bajo iluminación uniforme para evitar sombras. Marcadores en pecho y cuello sirven de referencia para integrar sus expresiones en personajes digitales.

A diferencia de la captura de movimiento tradicional, MotionScan registra múltiples ángulos simultáneamente para generar imágenes 3D. Emplea 32 cámaras HD de 2 megapíxeles (usadas por la NASA en lanzamientos espaciales [fuente: Gizmodo]), posicionadas en pares alrededor del actor, capturando hasta 30 fotogramas por segundo: 1 GB de datos por segundo.

Los datos se procesan en nueve servidores potentes (300 MB/s cada uno), generando texturas y formas animadas sincronizadas en tiempo real para marionetas digitales precisas.

Andy se anima En El Señor de los Anillos, la actuación de Andy Serkis con 25 cámaras se transformó en Gollum mediante 18 animadores y software que controlaba 10.000 movimientos faciales en 300 músculos virtuales.

¡Luces, cámara(s), acción en 3D!

La configuración de MotionScan incluye unos 1.000 equipos, que tardan hasta tres días en montarse con precisión.

La configuración de MotionScan incluye unos 1.000 equipos, que tardan hasta tres días en montarse con precisión.

Además de 16 pares de cámaras faciales, una cámara 33 ofrece vista general para el director, quien monitorea y guía al actor.

Se pide inmovilidad relativa para capturar detalles finos. Los animadores seleccionan ángulos y ajustan iluminación para escenas específicas, revelando emociones clave en el juego.

Un mentiroso evita el contacto visual; un amigo muestra sonrisas abiertas.

¡En tu cara, película!

L.A. Noire, un thriller criminal de los 40s, usa MotionScan para interrogatorios donde las expresiones delatan mentiras.

L.A. Noire, un thriller criminal de los 40s, usa MotionScan para interrogatorios donde las expresiones delatan mentiras.

La potencia de MotionScan automatiza ajustes, reduciendo tiempos y costos de producción.

L.A. Noire (lanzado en 2011) fue pionero, con Aaron Staton de Mad Men. Las expresiones impulsan la narrativa policiaca.

Depth Analysis licenciará MotionScan a más estudios. Futuro: captura de cuerpo completo, aunque desafiante.

Evolución del movimiento

Algunos sugieren personajes menos realistas para mayor inmersión.

Algunos sugieren personajes menos realistas para mayor inmersión.

Duplicar 19 músculos faciales requiere innovación como MotionScan.

Remedy desarrolla tecnología con 64 poses base, considerando flujo sanguíneo y cambios cutáneos.

Avances hiperrealistas combaten el "valle inquietante": representaciones demasiado realistas pueden resultar perturbadoras.

Equilibrar realismo y engagement es clave para juegos adictivos.

MotionScan eleva los videojuegos a nuevas cotas de realismo y emoción.